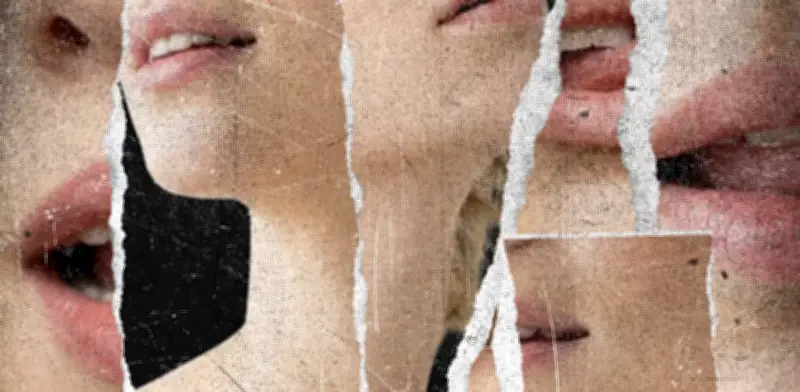

Ley Olimpia se queda sin dientes ante contenido sintético generado por IA

La rápida evolución de la inteligencia artificial generativa ha superado con creces la velocidad de respuesta del marco jurídico mexicano. Aunque la Ley Olimpia marcó un hito histórico en 2018 al sancionar la violencia digital, hoy enfrenta una obsolescencia técnica alarmante que impide proteger adecuadamente a las víctimas de contenidos sintéticos, especialmente los deepfakes que afectan desproporcionadamente a las mujeres.

Laguna legal que deja a víctimas en indefensión

Claudia Jiménez, presidenta del Consejo Latinoamericano de Ética en Tecnología (CLETec), advierte que la normativa actual carece de los mecanismos necesarios para castigar la creación de materiales falsos. "La Ley Olimpia se queda sin dientes en contenido de IA generativa", afirma Jiménez, destacando que el problema fundamental reside en que la ley fue concebida para castigar la difusión de contenido real sin consentimiento, pero no contempla la fabricación total de identidades digitales.

Según la especialista, al no mencionarse de manera "implícita y explícita que los videos son generados por inteligencia artificial", se genera una laguna jurídica que los juzgadores no pueden sortear, dejando a las víctimas en completa indefensión legal. Esta situación se agrava por la falta de conceptos claros sobre inteligencia artificial dentro del sistema de justicia.

El emblemático caso del IPN que expuso las fallas

La presidenta del CLETec recuerda el caso paradigmático de Diego "N", estudiante del Instituto Politécnico Nacional que manipuló fotografías de sus compañeras para crear imágenes desnudas mediante IA. En diciembre de 2024, un juez absolvió al joven de 19 años, quien estaba acusado de alterar miles de fotos de estudiantes para fines sexuales.

El magistrado justificó su decisión argumentando que "no había elementos suficientes" para demostrar culpabilidad en el delito contra la intimidad sexual, a pesar de que la investigación de la Fiscalía General de Justicia de Ciudad de México encontró en su posesión:

- 166 mil fotografías alteradas

- 20 mil videos y compilaciones

- 40% de material correspondiente a alumnas del Politécnico (17-25 años)

Este caso se ha convertido en el más icónico documentado sobre violencia digital con inteligencia artificial hacia mujeres universitarias a nivel mundial, relacionado con mercados de explotación sexual y producción de contenidos no consentidos.

Obstáculos fundamentales para la regulación

Uno de los mayores desafíos para establecer una regulación efectiva es determinar la cadena de responsabilidad legal:

- El usuario que introduce el comando (prompt)

- El desarrollador de la herramienta de IA

- La plataforma que permite su distribución

Jiménez recalca que México debe impulsar una regulación que establezca "mínimos de buen uso" sin caer en la sobrerregulación que inhiba la innovación, pero enfocada en proteger a grupos vulnerables. "En la inteligencia artificial se amplifica el daño porque estás hablando de entrenamientos masivos con millones de datos expuestos, sin que se sepa de dónde se han extraído", explica la experta.

Deuda legislativa y riesgo democrático

A nivel legislativo, existen cerca de 86 iniciativas en el Congreso de la Unión que permanecen en la "congeladora", evidenciando una falta de voluntad política para definir una estrategia nacional de IA que incluya la ciberseguridad, un tema que arrastra un rezago de dos décadas.

La presidenta del CLETec advierte sobre el peligro que representan los deepfakes en procesos democráticos: "La capacidad de generar audios y videos falsos de candidatos puede erosionar la confianza ciudadana y manipular la opinión pública de manera irreversible". Las redes sociales suelen escudarse en la libertad de expresión, pero Jiménez cuestiona: "¿Dónde está el límite de la libertad de expresión justamente por este tipo de videos?".

Camino hacia una regulación con dientes

El CLETec, que trabaja con certificadoras de Silicon Valley, busca fortalecer el ecosistema ético en América Latina mediante la alfabetización digital. La organización prepara el primer reporte diagnóstico sobre el uso de la IA en la región, buscando que las autoridades comprendan que, detrás de los algoritmos y el código, existen repercusiones humanas que requieren con urgencia un marco legal robusto.

Jiménez sostiene que no se trata de implementar tecnología por implementar, sino de entender su impacto social y sanitario: "Hay mucha brecha todavía y hay gente que puede ser dañada en su uso en términos de derechos humanos". El mal uso intencionado de la tecnología representa un riesgo histórico que ahora alcanza niveles de difusión masiva sin precedentes.

La opacidad de los algoritmos —conocida como "caja negra"— dificulta la rendición de cuentas, ya que es muy complejo que el sistema explique el paso a paso que tomó para llegar a cierta decisión. Esta falta de explicabilidad y transparencia representa un desafío adicional para la justicia en la era de la inteligencia artificial.